Community Management: Moderation gegen Gewalt

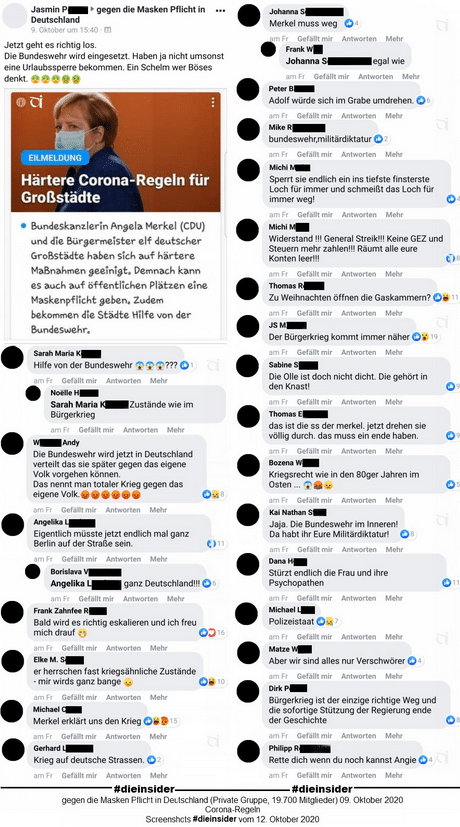

So oder so ähnlich sieht es in vielen Kommentarspalten auf Twitter, Facebook oder anderen Plattformen aus. Kommentare, die Angst verbreiten und Hass schüren sollen, dominieren viele politische Debatten im Internet:

Spätestens seit der Bundestagswahl 2017 wissen wir: Hass im Netz entsteht in vielen Fällen nicht zufällig. Er wird gezielt eingesetzt, um öffentliche Diskussionen zu manipulieren. Das machen sogenannte Trollarmeen – tausende von Nutzer*innen mit Fake Profilen, die die Kommentarspalten aktiv kapern und zumeist rechte Narrative setzen.

Nächstes Jahr sind wieder Bundestagswahlen. Wir können uns also fast sicher sein, dass rechte Netzwerke dieses Instrument, das sie auch schon in den USA und in Großbritannien angewandt haben, auch in Deutschland wieder nutzen werden. Und genau hier kommt der Bereich in einer Redaktion zum Zug, der leider häufig vernachlässigt wird: das Community Management. Dabei ist es ein effektives Werkzeug: Hetze in den Kommentarspalten kann maßgeblich reduziert werden. Nutzer*innen, die nicht an einem Diskurs interessiert sind, sondern lediglich ihren Hass loswerden möchten, können vor aller Augen enttarnt werden. Wie das am besten gelingt? Mit folgenden Handlungstipps:

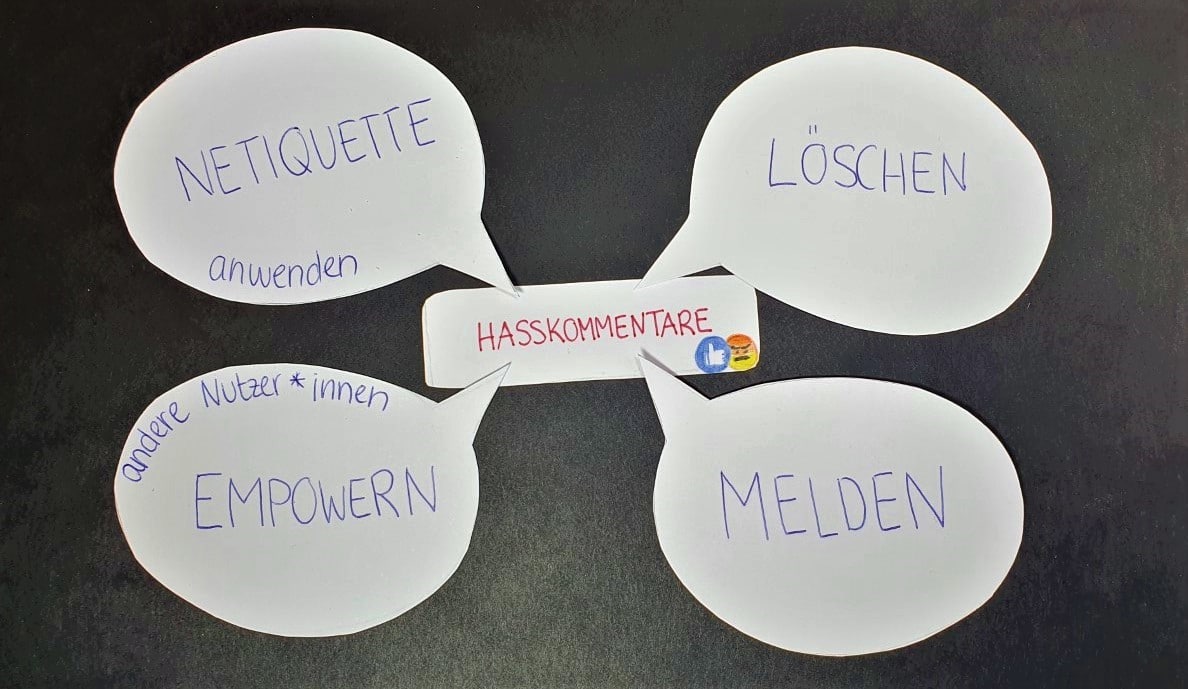

Empowern

Fangen wir mit einer schönen Sache an: Empowerment von progressiven User*innen. Denn das sind die Personen, die auf euren Seiten ernsthaft diskutieren, manchmal auch streiten wollen, aber immer fair und respektvoll. Sie zu empowern bedarf auch nicht viel Zeit: Es reicht ein Like, ein Dankeschön, ein Herz – einfach ein Zeichen aus der Redaktion, das signalisiert, dass ihr Einsatz nicht ungesehen ist und nicht für selbstverständlich genommen wird. Darum: Nehmt euch die Zeit und gebt diesen Menschen etwas zurück.

Netiquette

Wer in den sozialen Medien präsent sein möchte, sollte unbedingt die Netiquette mitdenken. Diese beinhaltet die Regeln für eure sozialen Kanäle. Dort können die User*innen nachlesen, welche Art von Verhalten auf euren Seiten erwünscht ist und welche nicht. Hier könnt Ihr deutliche Grenzen setzen – gerne auch mit Paragraphen untermauert. Beispielsweise gibt es die sogenannten Straftaten gegen die Ehre und auch bei Volksverhetzung (§130 StGB) findet die Meinungsfreiheit ihre Grenzen. Community Manager*innen können die Netiquette unter Beiträgen posten, unter denen viel gelöscht wird. Das sorgt für Transparenz und macht die Handlungen nachvollziehbar. Solltet ihr noch keine Netiquette haben und euch nicht vorstellen können, wie sie aussehen soll, könnt ihr unsere als Beispiel nehmen.

Löschen

Wer im Community Management arbeitet, wird sicher das ein oder andere Mal das Gefühl gehabt haben, dass deutlich mehr Hate unter den Beiträgen zu lesen ist als positive Kommentare. Das ist aber kein Anlass zum Verzweifeln! Einmal kurz durchatmen und sich noch einmal die eigene Netiquette verinnerlichen. In dieser stehen die Spielregeln genauestens drin. Bedeutet: Alles, was gegen die Netiquette verstößt, darf und sollte konsequent gelöscht werden. Dabei ist es egal, wenn der zehnte Kommentar, der z. B. Geflüchteten im Mittelmeer das Ertrinken wünscht, schon hunderte Likes hat. Hass, Beleidigungen und Hetze tragen nichts zum Dialog bei und sind eventuell sogar justiziabel.

Melden

In vielen Fällen genügt es nicht, die Kommentare einfach zu löschen. Wenn sie eindeutig zu weit gehen, können sie über die plattformeigenen Community-Richtlinien beim Netzwerk gemeldet werden. Wenn sie sogar gegen bestehende Gesetze verstoßen könnten, dann solltet Ihr sie unbedingt über das NetzDG-Meldeformular melden. Das NetzDG nimmt die Anbieter*innen in die Pflicht zu handeln: Sie müssen prüfen (lassen), ob ein Gesetzesverstoß vorliegt und wenn ja, Konsequenzen ziehen: Die Inhalte werden gelöscht.

Es ist wichtig, Hasskommentare zur Anzeige zu bringen.

Dass Strafanzeigen durchaus erfolgreich sind, zeigt ein aktuelles Beispiel: Eine Jägerin postete 2018 ein Foto mit einem von ihr erlegten Fuchs. In kürzester Zeit hatte sie einen heftigen Shitstorm. Sie wurde aufs Übelste beleidigt. Je mehr Reichweite der Beitrag erhielt, umso mehr Hassrede bekam sie zu lesen. Sie hat viele Grenzübertritte zur Anzeige gebracht und in mehr als 50 Fällen Recht bekommen. Geldstrafen in Höhe von mehreren 10.000 € plus die Übernahme von Prozesskosten kamen zusammen.

Keine Aufmerksamkeit den Trollen

Eine wichtige Strategie von rechtsextremen Trollarmeen ist es, unzählige Hasskommentare abzusetzen und so ihr Narrativ prominent zu setzen. Deshalb ist es wichtig, sich immer bewusst zu sein, dass der Hass unter einem polarisierenden Beitrag nicht durch Zufall dort entladen wird, sondern oft Teil einer gezielten Hass-Kampagne sein könnte. Die meisten dieser Kommentare bewegen sich in der Grauzone und verstoßen nicht gegen die Netiquette oder gar Gesetze. Diese Profile möchten die maximale Aufmerksamkeit erzielen. Und genau die bekommen sie, wenn der*die Seitenbetreiber*in auf sie reagiert und mit ihnen in den Dialog tritt. Sie würden dann auch sofort versuchen, das Community Management in eine One-to-One-Kommunikation zu verwickeln. Denn: Je mehr Antworten unter einem Kommentar stehen, je mehr Bewegung darunter passiert, umso höher ranken die Algorithmen der sozialen Medien diesen Kommentar und er steht weiter oben. Deswegen ist es wichtig, diese Trolle zu erkennen und besser zu ignorieren. „Don’t feed the troll” ist nicht ohne Grund eine der wichtigsten Regeln in den sozialen Netzwerken.

Mit Fakten gegen Hass und „Unwissen”

Die Aufgaben des Community Managements bestehen aber nicht nur darin, Kommentare zu löschen, zu liken und zu ignorieren. Eine sehr wichtige Aufgabe ist auch das inhaltliche Reagieren auf Kommentare. Ganz besonders, wenn diese kritisch sind, sich im Graubereich befinden und nicht von einem Troll stammen. Da ist es wichtig, zu reagieren und mit Fakten entgegenzuwirken. Beispielsweise wenn jemand unter einem Beitrag zur Seenotrettung den sogenannten „Pull-Effekt” aufgreift, also die Behauptung, dass ALLE nach Deutschland kommen wollen würden. Da kann das Community Management aufzeigen, wie viele Millionen Menschen weltweit auf der Flucht sind, wie viele davon sich in Europa aufhalten und wie viele nach Deutschland kommen. Wichtig ist es, inhaltlich zu antworten, Quellen zu verwenden und damit Fakten aufzuzeigen. Es geht dabei in erster Linie nicht darum, den*die Verfasser*in zu überzeugen, sondern das Bild für die zahlreichen stillen Mitleser*innen gerade zu rücken. Folgende Seiten können euch dabei helfen:

CORRECTIV – Recherchen für die Gesellschaft

Der VOLKSVERPETZER

MIMIKAMA

Tagesschau – ARD-faktenfinder

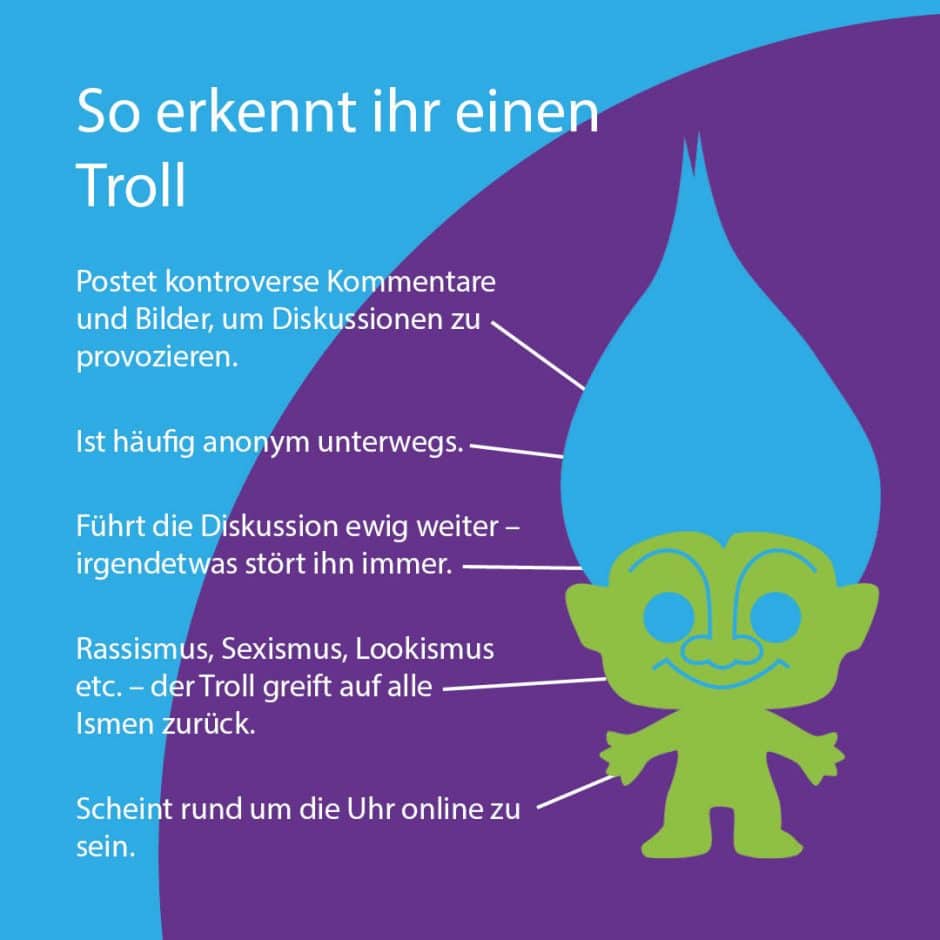

P. S. Woran erkenne ich einen Troll?

Man liest den Satz immer wieder und auch wir haben ihn hier schon verwendet: „Don’t feed the troll”. Aber wie kann man Trolle erkennen und von Kritiker*innen unterscheiden, die eventuell sogar bereit für eine Diskussion wären?

Trolle sind Nutzer*innen im Netz, die den Diskurs gerne aufmischen und vom eigentlichen Thema ablenken. Ihr Ziel ist es, die Aufmerksamkeit auf sich zu ziehen. Ihre Accounts haben häufig keine Freund*innen oder Follower und haben oft kein Profilbild, auf dem sie zu sehen sind.